1. 교통 정리를 해주는 경찰관, 로드 밸런서

유명한 맛집에 손님이 몰리면 어떻게 될까요? 주방장 혼자서는 주문을 다 감당하지 못해 가게가 마비될 것입니다.

그래서 맛집은 주방장(서버)을 여러 명 두고, 입구에서 지배인(로드 밸런서)이 손님을 빈 자리로 안내합니다.

IT 인프라에서도 마찬가지입니다.

수만 명이 동시 접속하는 네이버나 카카오 같은 서비스는 서버 한 대로는 절대 감당할 수 없습니다.

수십 대의 서버를 뒤에 놓고, 앞단에서 트래픽을 골고루 분산시켜 주는 장비가 필수적인데, 이것이 바로 "로드 밸런서(Load Balancer)"입니다.

이 로드 밸런서는 OSI 7계층 중 어느 단계에서 데이터를 까보고 분류하느냐에 따라 L4와 L7으로 나뉩니다.

두 장비의 차이를 이해하는 것이 대용량 아키텍처 설계의 시작입니다.

2. L4 로드 밸런서: 겉봉투만 보고 분류한다

L4 스위치는 4계층인 전송 계층(Transport Layer)에서 동작합니다.

쉽게 말해 "IP 주소"와 "포트 번호"만 보고 트래픽을 나눕니다.

비유하자면, 우체국에서 편지 봉투에 적힌 "주소(IP)"만 보고 분류하는 것과 같습니다.

- 작동 방식: 들어오는 트래픽의 IP와 Port를 확인하고, 미리 설정된 알고리즘(순차적, 접속 적은 순 등)에 따라 뒷단의 서버들에게 기계적으로 분산합니다.

- 장점: 속도가 매우 빠르고 효율적입니다. 데이터를 깊게 분석하지 않기 때문에 장비 부하가 적고 가격도 L7보다 저렴합니다.

- 단점: 사용자가 어떤 요청을 했는지(쇼핑인지, 검색인지)는 알 수 없어서 정교한 분산은 불가능합니다.

3. L7 로드 밸런서: 편지 내용을 읽고 분류한다

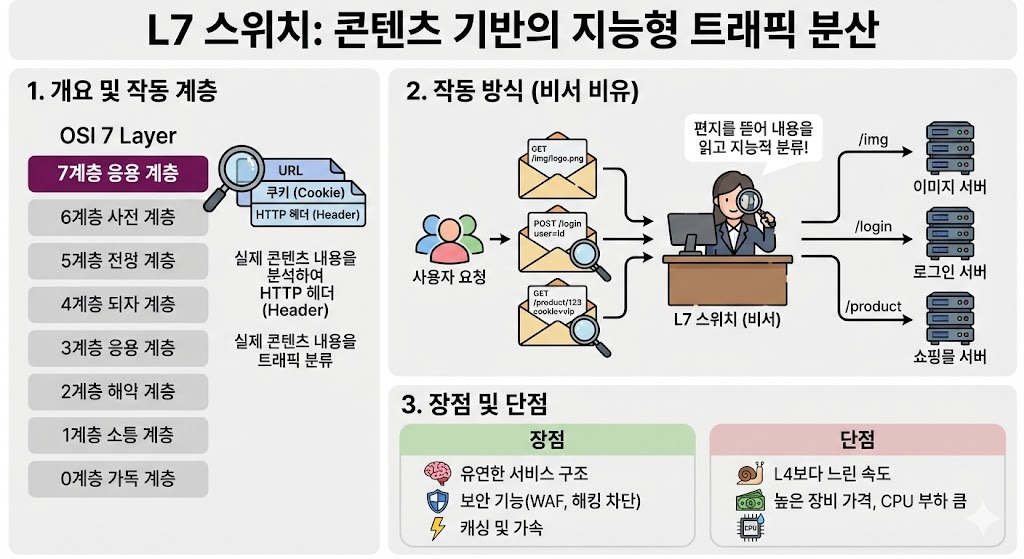

L7 스위치는 최상위 계층인 응용 계층(Application Layer)에서 동작합니다.

"URL", "쿠키(Cookie)", "HTTP 헤더" 같은 실제 콘텐츠 내용을 뜯어보고 트래픽을 나눕니다.

비유하자면, 비서가 편지 봉투를 뜯어서 "내용"을 읽어보고 분류하는 것입니다. "아, 이건 결제 관련 내용이네? 결제팀으로 보내야지.", "이건 이미지 요청이네? 이미지 서버로 보내야지."

- 작동 방식: 사용자가 /img 주소로 접속하면 이미지 서버로, /login 주소로 접속하면 로그인 서버로 보내는 식의 "콘텐츠 기반 라우팅"이 가능합니다.

- 장점: 서비스 구조를 유연하게 짤 수 있습니다. 보안 기능(WAF)을 추가하여 해킹 시도(SQL 인젝션 등)를 걸러낼 수도 있고, 캐싱 기능을 통해 속도를 높일 수도 있습니다.

- 단점: 패킷 내용을 복호화하고 분석해야 하므로 L4보다 느리고, 장비 가격이 비쌉니다. (CPU를 많이 씁니다.)

4. 언제 무엇을 써야 할까?

무조건 기능이 많은 L7이 좋을까요? 아닙니다. 상황에 맞는 적절한 조합이 필요합니다.

- 단순한 트래픽 분산이 목적이라면?-> L4 스위치

단순히 웹 서버 10대에 부하를 1/10로 나누기만 하면 된다면, 굳이 비싸고 느린 L7을 쓸 이유가 없습니다.

TCP/UDP 레벨의 고속 처리가 필요한 게임 서버나 금융권 코어 뱅킹 등에서 주로 사용합니다. - 마이크로서비스(MSA)나 기능별 분리가 필요하다면? -> L7 스위치

쇼핑몰처럼 상품 목록, 장바구니, 결제 페이지가 각각 다른 서버에서 돌아가는 구조라면 L7이 필수입니다.

URL 경로(Path)에 따라 트래픽을 찢어줘야 하기 때문입니다.

최근 클라우드 환경(AWS ALB 등)에서는 L7 방식이 기본으로 자리 잡고 있습니다.

5. 결론: 안정적인 서비스를 위한 이중 방어선

실제 대규모 데이터센터에서는 이 둘을 섞어서 씁니다.

가장 앞단에는 L4를 두어 거대한 트래픽을 1차로 거르고, 그 뒤에 L7을 두어 서비스별로 정교하게 나누는 구조입니다.

서버 한 대가 죽어도 서비스는 멈추지 않아야 합니다.

로드 밸런서는 고장 난 서버를 자동으로 감지해서 트래픽을 제외(Health Check)시키는 역할도 합니다.

"사용자는 우리가 서버를 껐다 켜는지조차 모르게 하라." 이 무중단 서비스의 미션을 완수하기 위해, 로드 밸런서는 오늘도 묵묵히 교통 정리를 하고 있습니다.

📌 함께 읽어보면 좋은 글

로드 밸런서가 트래픽을 나눠주는 뒷단의 서버들은 보통 두 대 이상이 한 팀으로 움직입니다. 서버가 죽어도 서비스가 살아남는 이중화 구성(Active-Active vs Active-Standby)의 원리를 알아보세요.

🔗 이중화(HA) 구성: 서버 한 대가 죽어도 서비스는 계속된다 글 보러가기

또한, L4 로드 밸런서가 다루는 TCP와 UDP 프로토콜의 차이를 이해하면 네트워크 트래픽의 성격을 파악하는 데 큰 도움이 됩니다.

'IT > 네트워크' 카테고리의 다른 글

| 네트워크 장애 해결사 Wireshark(와이어샤크), 패킷 뜯어보는 법 (0) | 2026.01.15 |

|---|---|

| 네트워크/인프라 L2, L3, L4 스위치 정리: 차이점부터 실제 구성 방식까지 (0) | 2026.01.08 |

| NAT와 포트포워딩: 집 공유기 아래 있는 내 서버를 외부에서 접속하게 하려면? 사설 IP와 공인 IP 변환의 마법 (0) | 2026.01.02 |

| 광모듈(SFP/SFP+): 광케이블 꽂는 구멍. GBIC과 SFP의 차이, 그리고 광케이블 타입별 매칭 가이드 (1) | 2025.12.27 |

| TCP/IP와 UDP: 유튜브 볼 때 끊겨도 되는 이유? UDP의 특징과 TCP와의 결정적 차이 (0) | 2025.12.26 |